对于大多数创业者来说,筹集资金是实现其发展雄心并取得成功的关键。说服投资者为初创企业提供资金可能会很困难,因为存在一定信息差。

投资者虽然掌握更多行业知识与运作逻辑,但往往只有创业者本人更了解自己的创业动机、目标市场与发展规划。因此,投资者部分依赖创业者提供的信息来减少这种不对等的信息差。这些信息包括创业者的具体行动如投入个人财富,也包括创业者表现出的某些情绪如解决问题的激情或喜悦,这都能帮助他们说服投资者进行投资。

本文研究中Daan Dinkla与其团队使用不同背景下的学生创业者和专业投资者样本,复制了过往研究结果,并使用 FaceReader 研究了情绪效应背后的机制。

情感体验的高峰时刻

与 Jiang 等人(2019)的研究一样,Dinkla研究了积极情绪的特定时刻,即峰值强度。那么,为什么是峰值强度?

在对事件进行回顾性评估和总结时,并非每个时刻都同样重要。事实表明,人们最依赖的是事件中体验到的情绪的峰值时刻。

投资者受到的情绪感染

使用FaceReader记录分析推介时的面部表情

研究中如何测量情绪?

实验研究要求学生创业者们在一次演讲比赛中,面对三位专业投资人提出了自己的创业想法。为了衡量演讲成功与否,投资人被要求说明他们对学生所演讲的初创企业的投资意愿。在演讲过程中,对学生和投资者进行录像。他们的面部表情由诺达思的面部表情分析系统(FaceReader)进行记录分析。

面部表情分析系统 (FaceReader)

面部表情分析系统 (FaceReader)

FaceReader 是经过科学验证的自动面部识别软件,其准确性与人类编码员相似甚至更高(Lewinski, den Uyl & Butler, 2014)。软件基于面部动作编码系统(FACS)和深度学习算法,能够分辨面部表情中的六种基本情绪:快乐、悲伤、愤怒、惊讶、害怕、厌恶,以及中性状态。

主要通过识别面部表情中的面部动作单元(AU)来划分情绪。这些动作单元是视觉上可分辨的最小面部动作,其中一些动作单元的组合能够表明某种情绪的表达。例如“快乐”的特征是两个动作单元的组合:嘴角上扬和脸颊上扬。研究借助FaceReader 能够将每段视频中每一帧的面部肌肉运动自动归类为情绪。

主要通过识别面部表情中的面部动作单元(AU)来划分情绪。这些动作单元是视觉上可分辨的最小面部动作,其中一些动作单元的组合能够表明某种情绪的表达。例如“快乐”的特征是两个动作单元的组合:嘴角上扬和脸颊上扬。研究借助FaceReader 能够将每段视频中每一帧的面部肌肉运动自动归类为情绪。

免费白皮书

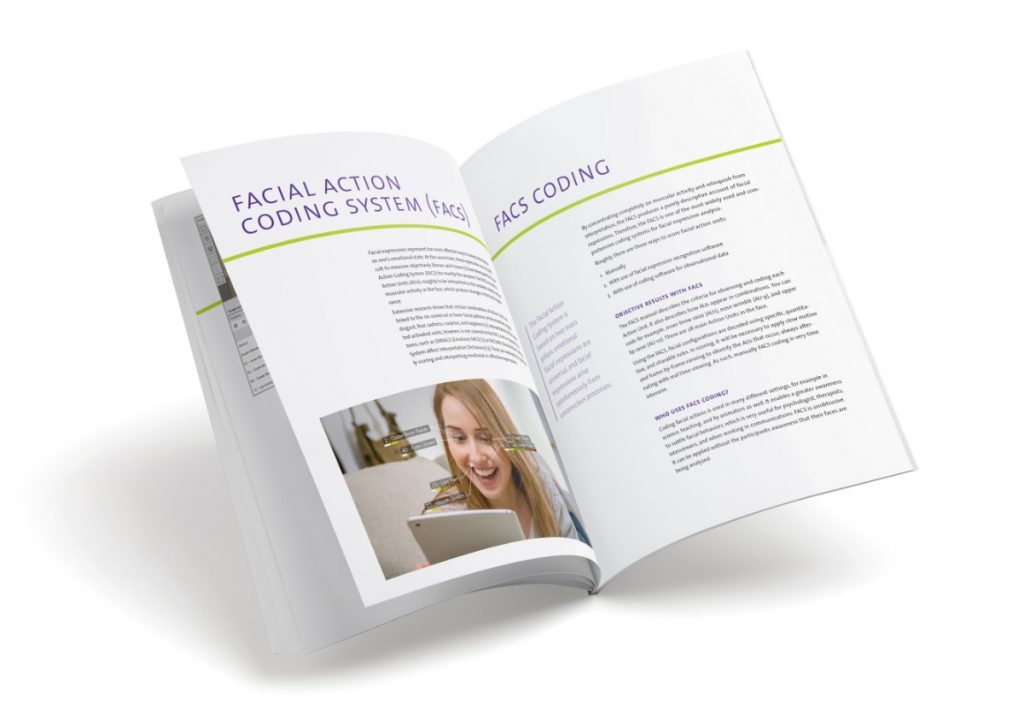

面部动作编码系统 (FACS)

面部表情编码可用于许多不同的环境中,例如科学,教学以及动画建模。它使人们对细微的面部行为有了更深入的认识。随着计算机视觉技术的发展,目前您可以通过可靠的工具自动进行面部动作编码。

下载免费白皮书,了解更多:

- 如何客观地衡量面部动作单元的活动

- 哪些研究工具可以为您的研究提供所需的结果

- 使用FACS进行编码的好处

情绪模仿会带来投资吗?

那么,表现快乐情绪会产生哪些影响呢?

研究者发现,情绪模仿的发生与高峰时刻的快乐情绪有关。创业者表现出越强烈的快乐情绪,情绪模仿就越有可能发生。然而,这种模仿并不会影响投资意愿。投资者模仿创业者的情绪与他们的投资意愿之间没有显著关系。

对这一结果的可能解释是投资者在做出投资决定时,能够消除自己的情绪状态,而主要关注推介的其他更具体的方面。或者,投资者会在潜意识中模仿创业者,但这种模仿并不会导致情绪感染。过往研究也表明,模仿并不总是导致情绪感染。

情绪在决策过程中的影响

本研究结果也表明,创业者表现出的快乐会对投资者的投资意愿产生负面影响。有趣的是,这与 Jiang 等人(2019)的研究结果正好相反,即表达快乐对创业者筹集的资金额有积极影响。

造成不同结果的原因可能是什么?

这两项研究之间存在一些差异。主要差异是本研究主要研究的是学生向专业投资人推介,而 Jiang 等人研究的是非现场的推介视频。不同类型的受众(专业受众与大部分消费者)在决策过程中依赖情绪或受情绪影响的程度可能存在差异。因此,关于在推介过程中表达情绪所会产生何种效果依旧没有定论。未来研究或许可以更详细地确定情绪何时以及如何影响推介结果。

参考文献

Jiang, L., Yin, D., & Liu, D. (2019). Can joy buy you money? The impact of the strength, duration, and phases of an entrepreneur’s peak displayed joy on funding performance. Academy of Management Journal, 62(6), 1848-1871.

Lewinski, P., den Uyl, T. M., & Butler, C. (2014). Automated facial coding: validation of basic emotions and FACS AUs in FaceReader. Journal of Neuroscience, Psychology and Economics, 7(4), 227.