在婴儿语言发展关键期,准确感知语音对后续能力发展至关重要。

传统研究多依赖注视测量,却难全面捕捉婴儿复杂反应。本研究聚焦婴儿语音感知中面部情感变化,引入自动化面部表情分析,探究了婴儿在面对母语与非母语时的面部变化与感知调谐能力之间的关系,旨在挖掘面部表情分析作为注视测量补充的潜力,为早期语言发展研究提供更丰富、精准的工具与视角(Tsuji et al., 2025)

婴儿语言的感知调谐发展

婴儿在出生后的第一年内,其语言能力的发展经历了从广泛感知到精细区分的显著变化。最初,婴儿能够区分世界各种语言中的广泛音素对比,但随着年龄的增长,他们对非母语音素的敏感性逐渐下降,而对母语音素的区分能力则显著增强。这一过程被称为感知调谐(Perceptual Attunement),它反映了神经可塑性和突触修剪在关键发展期的作用,并与后期的语言技能正相关。

传统的感知调谐研究主要依赖于注视时间测量,即通过测量婴儿对新颖声音和熟悉声音的注视时间差异来判断其区分能力。然而,感知调谐并非一个统一的过程,它受到语言和社会环境丰富性的影响。例如,双语婴儿可能比单语婴儿需要更长的时间来调谐其语音类别,而社会互动丰富的环境则能增强婴儿对语音对比的习得。

鉴于这些多方面的影响,仅依赖注视时间这一单一测量指标可能无法全面捕捉婴儿在感知调谐过程中的丰富反应。而面部表情能提供关于婴儿情感状态和认知参与的额外信息,这些信息可能揭示感知调谐过程中更复杂的机制。

因此,本研究旨在探索将面部表情分析作为注视时间测量的补充工具,以更全面地理解婴儿在语音感知过程中的情感和认知反应。

利用Baby FaceReader捕捉婴儿情感变化

实验研究被试来自东京的日语单语婴儿,分为9个月和12个月两个年龄组。对于母语音素区分实验,9个月组有31名婴儿,12个月组有33名婴儿;对于非母语音素区分实验,9个月组有29名婴儿,12个月组有29名婴儿。

每个婴儿需要参与包含两组会话的实验,即使用母语刺激(日语)的会话和使用非母语刺激(英语)的会话。实验在隔音实验室中进行,视觉刺激显示在显示屏中,音频刺激通过屏幕下方的前置扬声器播放。婴儿坐在照顾者的腿上,照顾者佩戴降噪耳机播放音乐以屏蔽音频刺激。实验者通过摄像机观察婴儿,并通过按键记录其注视屏幕的情况。

实验采用改进的视觉习惯化范式,包括四个阶段:预测试、习惯化、测试和后测试。习惯化阶段持续呈现一种语音类型的刺激列表,伴随静态红黑棋盘格视觉刺激,直到婴儿达到习惯化标准。测试阶段包括四个试次:两个“转换”试次(呈现与习惯化不同的语音类型)和两个“相同”试次(匹配习惯化刺激)。其中,注视行为数据通过提取记录的按键数据来分析婴儿注视和远离屏幕的情况。

整个过程使用诺达思的婴幼儿面部表情分析系统(Baby FaceReader)进行记录分析。软件能够检测婴儿面部标志点并逐帧分析注视、头部方向和面部肌肉运动。Baby FaceReader根据面部动作编码系统(FACS)生成面部肌肉动作单元(Action Units, AU)数据,并组成特定表情的表达式;同时,系统会分析情绪效价和唤醒度。效价反映了整体的情绪基调,唤醒度表示强度。此外,研究者对由特定的消极情绪(AU3 +AU4)和积极情绪(AU12)进行了分析。

婴幼儿面部表情分析系统 (Baby FaceReader)

婴幼儿面部表情分析系统(Baby FaceReader)

语感能力引起情感变化

研究者首先分析了注视行为以评估感知调谐,使用线性混合效应模型分别对母语和非母语实验中的每个年龄组进行建模。结果表明,对于母语语音感知调谐,9个月和12个月的婴儿均表现出显著的区分能力。对于非母语语音感知调谐:9个月和12个月的婴儿均无显著区分能力。

接下来对面部表情进行三组验证性分析,以效价、唤醒度、积极情绪或消极情绪作为因变量创建混合效应模型。

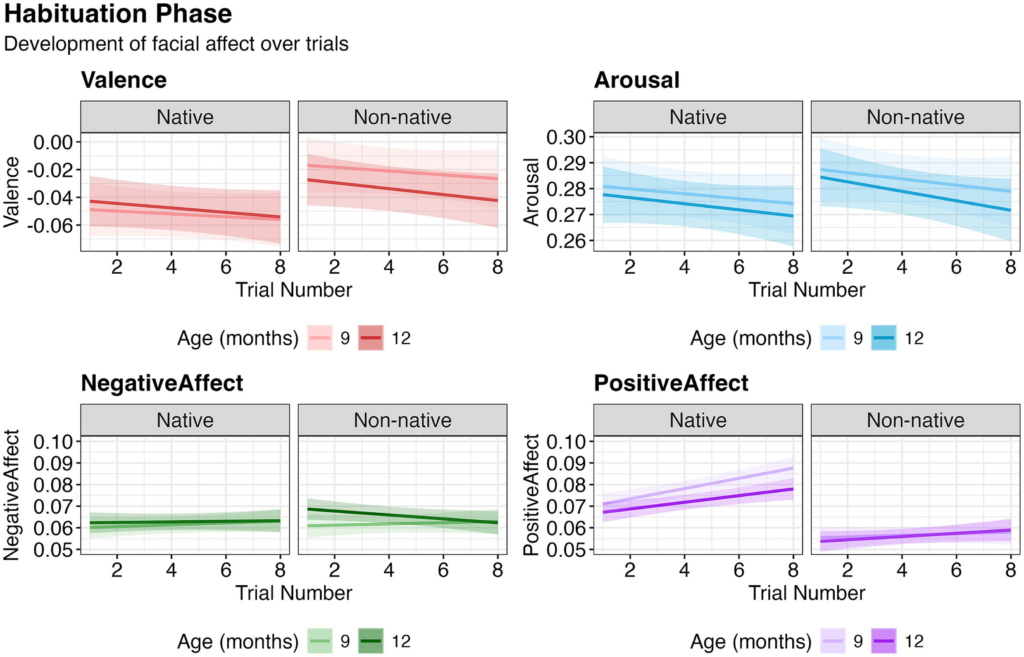

习惯化阶段的结果表明(图1),效价随着试次数量的增加显著下降。母语刺激的效价低于非母语刺激。年龄与母语性存在交互作用,9个月的婴儿在非母语刺激下的效价显著高于12个月的;唤醒度随着试次数量的增加显著下降。非母语刺激的唤醒度高于母语刺激;积极情绪随着试次数量的增加而显著增加,9个月的婴儿的积极情绪高于12个月的。母语刺激的积极情绪高于非母语刺激。测试阶段的结果显示,不同试次中面部表情没有出现显著差异,这表明这些条件可能不会引起情感反应的足够强烈的变化。

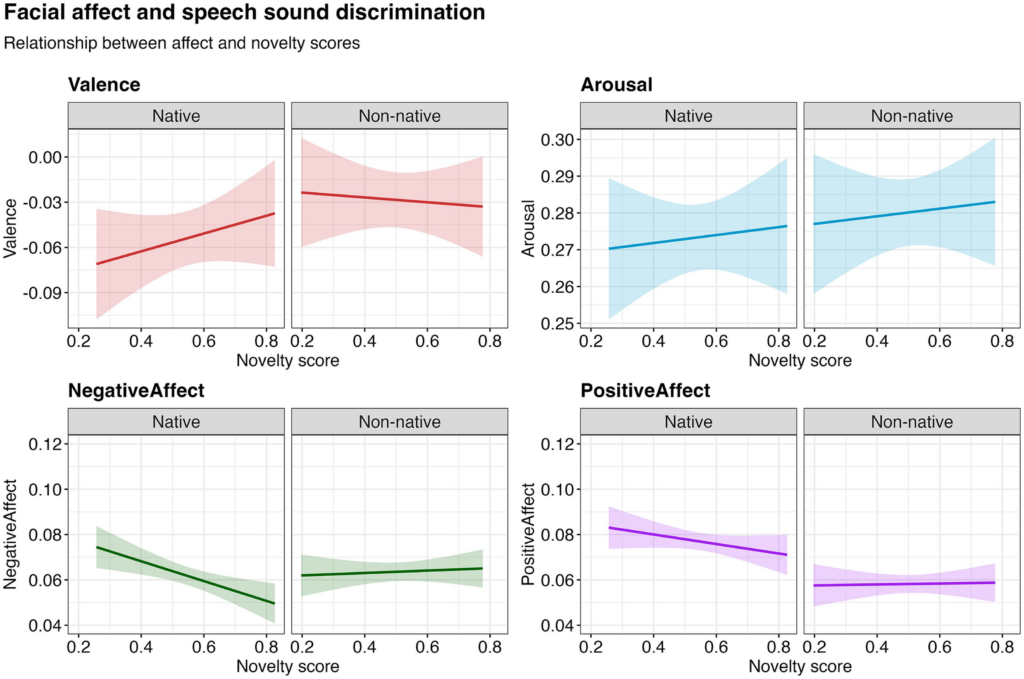

此外,结果表明面部情绪与母语语音区分能力有关,更好的区分能力与较低的负面情绪有关(图2)。这种模式可能表明,成功处理熟悉的对比会减少挫败感或消极反应。对母语的偏好也被认为反映了对信息的期望,目前的结果可能表明,在检测相关信息方面做得更好的婴儿表现出更好的感知调谐。

面部表情分析助力理解婴儿语言发展

本研究通过增加面部表情分析到传统的注视时间测量中,探索了婴儿在视觉习惯化范式中的面部情感反应,以更全面地理解其对母语和非母语语音的感知调谐。

研究结果表明,面部表情分析可以作为研究感知调谐的传统注视时间测量的补充工具,特别是在捕捉习惯化阶段的情感变化方面。然而,并非所有刺激都能引发可检测的面部情感差异,这可能受到刺激的非社交和非情感特性的限制。未来的研究可以进一步探索面部表情分析在不同实验设计和刺激类型中的应用,以更全面地理解婴儿在语音感知过程中的情感和认知反应。此外,将面部情感数据与婴儿的社会交流环境和语言结果测量相结合,可能有助于深化我们对婴儿情感反应和参与度如何影响语言学习的理解。

参考文献

Tsuji S, Alonso F, Hagihara H, Kimura N, Polka L and Lovčević I (2025) Facial affect and arousal as a complement to gaze measures in infant speech sound perception studies.Front. Neural Circuits 19:1553918.